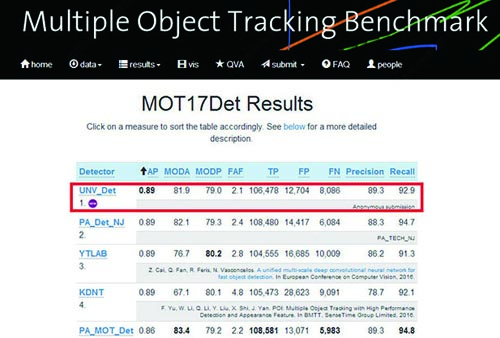

2019年3月,宇视科技(uniview)计算机视觉与深度学习算法在Multiple Object Tracking(MOT) Challenge全球竞赛刷新最好成绩,在MOT最新的数据集MOT17Det中,将交通场景目标检测的AP提高至0.89X,呈现最高识别准确率与最低误报率,以第一名成绩打破腾讯优图、商汤等AI算法名企创下的记录。

图 宇视算法突破高人流密度与遮挡等痛点,部署多场景,位列MOT Challenge多目标行人目标评测榜首位

MOT Challenge是国际多目标检测跟踪领域最权威的测评平台,评测多行人对象在复杂场景下进行同时检测及跟踪的算法性能。MOT竞赛每年举办,是世界各大AI研究机构、企业、高校角逐之地,MOT17Det采集自不同场景和多个拍摄角度下的素材,覆盖各种复杂情况、待检测目标,涉及欠曝和过曝场景、微小目标、目标被大量遮挡等。打榜的宇视算法AdaptNet 1.2版本,主要改进点为:

- 在已有的深度神经网络的基础上,融合了多尺度深度特征,提升对微小目标的表达能力。

- 提出了一种新的基于最大类间距的损失函数,可以提升目标遮挡情况下的检测精度。

- 采用一种新的注意力机制,进一步提升过曝和欠曝等难检目标的检出率。

图 宇视全系列AI产品以中国关山命名,六山两关产品中,仅『昆仑』重器就部署超过300个项目

专攻bob半岛综合登录 科目的宇视研发副总裁谢会斌表示:“本次取得排名世界第一,验证了我们AdaptNet网络模型的有效。宇视内部AI算法各团队代号以猫科动物命名,此次打榜的是‘陆虎’小组。2017年,宇视在KITTI评测中获得世界第一,侧重的是车道检测。优秀算法模型的产生,不仅是在实验室中的研究氛围和论文产出、集群算力投入,宇视引以为豪的还有在实战部署的项目中检验迭代。”

2019年以来,AdaptNet已运用于宇视前后端AI系列产品,如『天目』卡口/电警、『函谷』人体抓拍机、行业款『昆仑』数据结构化服务器等。安防+AI大规模部署,宇视将传统AI三要素演进为六要素:算法、算力、数据,产品、工程、方案,从IMOS操作系统到六山两关,实现了全系列AI产品在雪亮、平安、交通、企业、教育、金融等多场景的落地,以实战成果守护安全美好生活。

浙公网安备 33010802004032号

浙公网安备 33010802004032号